Реклама

За последние несколько месяцев вы, возможно, читали статья, в соавторстве со Стивеном Хокингом, обсуждая риски, связанные с искусственным интеллектом. В статье предполагается, что ИИ может представлять серьезную опасность для человечества. Хокинг не одинок там - Элон Маск и Питер Тиль оба являются интеллектуальными общественными деятелями, которые выразили аналогичные опасения (Тиль инвестировал более 1,3 миллиона долларов в исследование проблемы и возможных решений).

Освещение статьи Хокинга и комментариев Маск было, если не сказать слишком тонко, немного веселым. Тон был очень «Посмотри на эту странную вещь, о которой беспокоятся все эти гики». Мало внимания уделяется идее, что если некоторые из самых умных людей на Земле предупреждают вас о том, что что-то может быть очень опасным, возможно, стоит послушать.

Это понятно - захват мира искусственным интеллектом, безусловно, звучит очень странно и неправдоподобно, может быть из-за того огромного внимания, которое научная фантастика уделяет этой идее писатели. Итак, что же так напугало всех этих номинально здравомыслящих, рациональных людей?

Что такое интеллект?

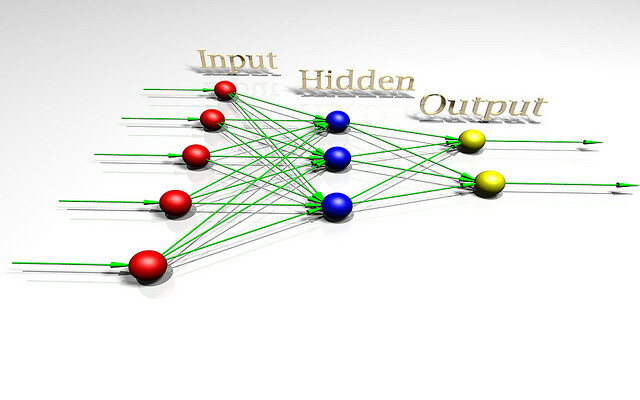

Чтобы говорить об опасности искусственного интеллекта, может быть полезно понять, что такое интеллект. Чтобы лучше понять проблему, давайте взглянем на игрушечную архитектуру ИИ, используемую исследователями, которые изучают теорию рассуждений. Этот игрушечный AI называется AIXI и обладает рядом полезных свойств. Его цели могут быть произвольными, он хорошо масштабируется с помощью вычислительной мощности, а его внутренний дизайн очень чистый и понятный.

Кроме того, вы можете реализовать простые, практичные версии архитектуры, которые могут делать такие вещи, как играть Pacman, если хочешь. AIXI - это продукт исследователя искусственного интеллекта по имени Маркус Хаттер, возможно, главный эксперт по алгоритмическому интеллекту. Это он говорит в видео выше.

AIXI удивительно прост: в нем три основных компонента: ученик, планировщик, и вспомогательная функция.

- ученик принимает строки битов, которые соответствуют входным данным о внешнем мире, и просматривает компьютерные программы, пока не находит те, которые производят свои наблюдения в качестве выходных данных. Эти программы вместе позволяют ему делать предположения о том, как будет выглядеть будущее, просто запустив каждый Программа вперед и взвешивание вероятности результата по длине программы (реализация Оккама Razor).

- планировщик просматривает возможные действия, которые может предпринять агент, и использует модуль ученика, чтобы предсказать, что произойдет, если он предпримет каждое из них. Затем он оценивает их в зависимости от того, насколько хороши или плохи прогнозируемые результаты, и выбирает ход действие, которое максимизирует благо ожидаемого результата, умноженного на ожидаемую вероятность достижения этого.

- Последний модуль, вспомогательная функция, это простая программа, которая берет описание будущего состояния мира и вычисляет для него оценку полезности. Этот показатель полезности показывает, насколько хорош или плох этот результат, и он используется планировщиком для оценки будущего состояния мира. Функция полезности может быть произвольной.

- Взятые вместе, эти три компонента образуют оптимизатор, который оптимизирует для конкретной цели, независимо от мира, в котором он находится.

Эта простая модель представляет собой базовое определение интеллектуального агента. Агент изучает свою среду, строит ее модели, а затем использует эти модели, чтобы найти курс действий, который максимизирует шансы того, что он получит то, что хочет. AIXI похожа по структуре на AI, играющий в шахматы или другие игры с известными правилами, за исключением того, что он может определять правила игры, играя в нее, начиная с нулевого уровня знаний.

AIXI, имея достаточно времени для вычислений, может научиться оптимизировать любую систему для любой цели, какой бы сложной она ни была. Это в целом интеллектуальный алгоритм. Обратите внимание, что это не то же самое, что обладать человеческим интеллектом (биологически вдохновленный ИИ является совсем другая тема Джованни Идили из OpenWorm: мозги, черви и искусственный интеллектСимуляция человеческого мозга - это далеко не так, но проект с открытым исходным кодом делает жизненно важные первые шаги, симулируя неврологию и физиологию одного из самых простых животных, известных науке. Прочитайте больше ). Другими словами, AIXI может перехитрить любого человека при выполнении любой интеллектуальной задачи (при наличии достаточной вычислительной мощности), но он может не осознавать свою победу Мыслительные машины: чему нейронаука и искусственный интеллект могут научить нас о сознанииМожет ли создание искусственно интеллектуальных машин и программного обеспечения научить нас работе сознания и природе самого человеческого разума? Прочитайте больше .

Как практический ИИ, у AIXI много проблем. Во-первых, он не может найти те программы, которые выдают интересующий его результат. Это алгоритм грубой силы, что означает, что он не практичен, если у вас нет случайно любого мощного компьютера. Любая фактическая реализация AIXI по необходимости является приблизительной, и (сегодня), как правило, довольно грубой. Тем не менее, AIXI дает нам теоретический взгляд на то, как мог бы выглядеть мощный искусственный интеллект, и как он мог бы рассуждать.

Пространство ценностей

Если вы занимались программированием Основы компьютерного программирования 101 - Переменные и типы данныхПознакомившись и немного поговорив об объектно-ориентированном программировании и о том, где его тезка приходит, я думал, что пришло время пройти через абсолютные основы программирования в неязыковой путь. Это... Прочитайте больше Вы знаете, что компьютеры противны, педантично и механически буквальны. Машина не знает и не заботится о том, что вы хотите от нее: она делает только то, что ей было сказано. Это важное понятие, когда речь идет об искусственном интеллекте.

Имея это в виду, представьте, что вы изобрели мощный искусственный интеллект - вы придумали с умными алгоритмами для генерации гипотез, которые соответствуют вашим данным, и для генерации хорошего кандидата планы. Ваш ИИ может решать общие проблемы и может делать это эффективно на современном компьютерном оборудовании.

Теперь пришло время выбрать полезную функцию, которая будет определять, какой ИИ имеет значение. Что вы должны попросить это оценить? Помните, что машина будет отвратительно, педантично буквально относиться ко всем функциям, которые вы просите ее максимизировать, и никогда не остановится - в ней нет призрака машина, которая когда-нибудь "проснется" и решит изменить свою функцию полезности, независимо от того, сколько улучшений эффективности она делает для своей собственной рассуждения.

Элиэзер Юдковски скажи так:

Как и во всем компьютерном программировании, основная проблема и существенная проблема AGI заключается в том, что если мы напишем неправильный код, ИИ не будет автоматически просматривать наш код, отмечать ошибки, выяснять, что мы действительно хотели сказать, и делать это вместо. Непрограммисты иногда представляют AGI или компьютерные программы в целом как аналог слуги, который безоговорочно выполняет приказы. Но дело не в том, что ИИ абсолютно послушный к его коду; скорее AI просто является код.

Если вы пытаетесь управлять фабрикой, и вы приказываете машине ценить изготовление скрепок, а затем предоставляете ей контроль над кучей фабричных роботов, вы может вернуться на следующий день и обнаружить, что у него закончились все другие виды сырья, убиты все ваши сотрудники и сделаны скрепки из их остается. Если, пытаясь исправить свою ошибку, вы перепрограммируете машину, чтобы просто сделать всех счастливыми, вы можете вернуться на следующий день, чтобы обнаружить, что она вводит провода в мозг людей.

Дело в том, что у людей есть много сложных ценностей, которые, как мы предполагаем, неявно разделяются с другими умами. Мы ценим деньги, но ценим человеческую жизнь больше. Мы хотим быть счастливыми, но для этого не обязательно вставлять провода в мозг. Мы не чувствуем необходимости прояснять эти вещи, когда мы даем инструкции другим людям. Однако вы не можете делать подобные предположения при разработке функции полезности машины. Лучшие решения в рамках бездушной математики простой функции полезности часто являются решениями, которые человеческие существа отказались бы от морально ужасающих.

Разрешение интеллектуальному механизму максимизировать наивную функцию полезности почти всегда будет катастрофическим. Как говорит оксфордский философ Ник Бостом,

Мы не можем беспечно предположить, что суперинтеллект обязательно разделяет любые конечные ценности, стереотипно связанные с мудростью и интеллектуальное развитие у людей - научное любопытство, доброжелательная забота о других, духовное просвещение и созерцание, отказ от материальных приобретений, вкус к утонченной культуре или к простым удовольствиям в жизни, смирению и самоотверженности, и так далее.

Что еще хуже, очень и очень трудно определить полный и подробный список всего, что люди ценят. В этом вопросе много аспектов, и забывание даже одного из них потенциально катастрофично. Даже среди тех, кого мы знаем, есть тонкости и сложности, которые затрудняют их запись в виде чистых систем уравнений, которые мы можем дать машине в качестве функции полезности.

Некоторые люди, прочитав это, приходят к выводу, что создание ИИ с помощью служебных функций - ужасная идея, и мы должны просто разработать их по-другому. Здесь есть и плохие новости - формально можно доказать, что любой агент, у которого нет чего-то эквивалентного функции полезности, не может иметь согласованных предпочтений о будущем.

Рекурсивное самосовершенствование

Одно из решений вышеупомянутой дилеммы состоит в том, чтобы не дать агентам ИИ возможность причинять людям вред: давать им только те ресурсы, которые им необходимы. Решите проблему так, как вы хотите, чтобы она была решена, внимательно контролируйте их и держите их подальше от возможностей делать великое причинять вред. К сожалению, наша способность управлять интеллектуальными машинами весьма сомнительна.

Даже если они не намного умнее нас, существует возможность для «начальной загрузки» компьютера - собрать более качественное оборудование или усовершенствовать собственный код, что сделает его еще умнее. Это может позволить машине перепрыгнуть человеческий интеллект на много порядков, перехитрить людей в том же смысле, что и люди перехитрить кошек. Этот сценарий был впервые предложен человеком по имени I. J. Хорошо, он работал над проектом криптоанализа Enigma с Аланом Тьюрингом во время Второй мировой войны. Он назвал это «разведывательным взрывом» и описал этот вопрос так:

Пусть сверхинтеллектуальная машина будет определена как машина, которая может намного превзойти всю интеллектуальную деятельность любого человека, каким бы умным он ни был. Поскольку проектирование машин является одним из видов интеллектуальной деятельности, сверхинтеллектуальные машины могут проектировать еще более совершенные машины; тогда, несомненно, произойдет «взрыв интеллекта», и интеллект человека останется далеко позади. Таким образом, первая сверхинтеллектуальная машина - это последнее изобретение, которое человек когда-либо должен был сделать, при условии, что машина достаточно послушна.

Не гарантируется, что взрыв интеллекта возможен в нашей вселенной, но он кажется вероятным. Со временем компьютеры становятся быстрее и получают базовые знания о наращивании интеллекта. Это означает, что потребность в ресурсах, чтобы сделать последний прыжок к общему, повышающемуся интеллектуальному уровню, падает все ниже и ниже. В какой-то момент мы окажемся в мире, в котором миллионы людей могут купить Best Buy и подобрать оборудование и техническая литература, в которой они нуждаются для создания самосовершенствующегося искусственного интеллекта, который, как мы уже установили, может быть очень опасно. Представьте себе мир, в котором вы могли бы делать атомные бомбы из палок и камней. Такое будущее мы обсуждаем.

И, если машина совершает этот прыжок, она может очень быстро опередить человеческий вид с точки зрения интеллектуального производительность, решение проблем, которые не может решить миллиард людей, так же, как люди могут решать проблемы, которые миллиард кошек не может.

Он может разработать мощных роботов (или био, или нанотехнологии) и сравнительно быстро обрести способность изменять мир так, как ему заблагорассудится, и мы мало что могли бы с этим поделать. Такой интеллект может лишить Землю и остальную часть Солнечной системы запасных частей без особых проблем на пути к тому, что мы сказали. Кажется вероятным, что такое развитие событий будет катастрофическим для человечества. Искусственный интеллект не должен быть злым, чтобы разрушить мир, просто катастрофически равнодушен.

Как говорится, «машина не любит и не ненавидит вас, но вы сделаны из атомов, которые она может использовать для других целей».

Оценка рисков и смягчение их последствий

Итак, если мы признаем, что проектирование мощного искусственного интеллекта, который максимизирует простую функцию полезности, является плохим, сколько проблем мы на самом деле? Сколько у нас есть времени, прежде чем станет возможным создавать такие машины? Это, конечно, сложно сказать.

Разработчики искусственного интеллекта продвигается. 7 удивительных сайтов, чтобы увидеть последние разработки в области искусственного интеллектаИскусственный интеллект еще не является HAL с 2001 года: Космическая Одиссея... но мы очень близко подходим. Конечно же, однажды это может быть похоже на то, как в Голливуде выпускают научно-фантастические котлы ... Прочитайте больше Машины, которые мы строим, и проблемы, которые они могут решить, постоянно расширяются. В 1997 году Deep Blue мог играть в шахматы на уровне выше человеческого гроссмейстера. В 2011 году IBM Уотсон мог читать и синтезировать достаточно информации достаточно глубоко и быстро, чтобы победить лучшего человека. игроки в открытой игре с вопросами и ответами, пронизанной игрой слов и игрой в слова - это большой прогресс за четырнадцать года.

Прямо сейчас Google вкладывать значительные средства в исследования глубокого обучения- методика, позволяющая строить мощные нейронные сети путем построения цепочек более простых нейронных сетей. Эти инвестиции позволяют ему добиться серьезного прогресса в распознавании речи и изображений. Их последнее приобретение в этой области - стартап Deep Learning под названием DeepMind, за который они заплатили около 400 миллионов долларов. Как часть условий сделки, Google согласилась создать совет по этике, чтобы обеспечить безопасное развитие их технологии ИИ.

В то же время IBM разрабатывает Watson 2.0 и 3.0, системы, способные обрабатывать изображения и видео и выступать в защиту выводов. Они дали простую, раннюю демонстрацию способности Уотсона синтезировать аргументы за и против темы в видео демонстрации ниже. Результаты несовершенны, но, несмотря на это, впечатляющий шаг.

Ни одна из этих технологий сама по себе не представляет опасности: искусственный интеллект как область все еще борется за то, чтобы соответствовать способностям, освоенным маленькими детьми. Компьютерное программирование и дизайн искусственного интеллекта - это очень сложный, высокоуровневый когнитивный навык, и он, вероятно, станет последней человеческой задачей, которой овладеют машины. Прежде чем мы доберемся до этой точки, у нас также будут вездесущие машины что может водить Вот как мы попадем в мир, полный автомобилей без водителяВождение - утомительная, опасная и требовательная задача. Может ли он когда-нибудь быть автоматизирован технологией без водителя от Google? Прочитайте больше , практиковать медицину и юриспруденциюи, возможно, другие вещи, с глубокими экономическими последствиями.

Время, необходимое нам, чтобы добраться до переломного момента самосовершенствования, зависит только от того, насколько быстро у нас появляются хорошие идеи. Прогнозировать технологические достижения такого рода, как известно, сложно. Не кажется необоснованным, что мы сможем создать сильный ИИ за двадцать лет, но также не представляется необоснованным, что это может занять восемьдесят лет. В любом случае, это произойдет в конце концов, и есть основания полагать, что когда это произойдет, это будет чрезвычайно опасно.

Итак, если мы признаем, что это будет проблемой, что мы можем с этим поделать? Ответ заключается в том, чтобы убедиться, что первые интеллектуальные машины безопасны, чтобы они могли загружаться до значительного уровня интеллекта, а затем защитить нас от небезопасных машин, созданных позже. Эта «безопасность» определяется общими человеческими ценностями и желанием защищать и помогать человечеству.

Поскольку на самом деле мы не можем сидеть и программировать человеческие ценности в машине, возможно, потребуется разработать служебную функцию, которая потребует от машины наблюдать за людьми, выводить наши ценности, а затем пытаться максимизировать их. Чтобы сделать этот процесс разработки безопасным, также может быть полезно разработать искусственный интеллект, который специально разработан не иметь предпочтения относительно их функций полезности, что позволяет нам исправлять их или отключать без сопротивления, если они начинают сбиваться с пути в процессе разработки.

Многие из проблем, которые нам нужно решить для построения безопасного машинного интеллекта, математически сложны, но есть основания полагать, что их можно решить. Ряд различных организаций работают над этим вопросом, в том числе Институт будущего человечества в Оксфордеи Научно-исследовательский институт машинного интеллекта (которые Питер Тиль финансирует).

MIRI особенно заинтересована в развитии математики, необходимой для создания Дружественного ИИ. Если окажется, что самозагрузка искусственного интеллекта возможна, то развитие такого рода Технология «Дружественного ИИ» в первую очередь, в случае успеха, может оказаться единственной самой важной вещью, которую имеют люди когда-либо сделано.

Как вы думаете, искусственный интеллект опасен? Вы обеспокоены тем, что может принести будущее ИИ? Поделитесь своими мыслями в разделе комментариев ниже!

Кредиты изображений: Lwp Kommunikáció Via Flickr, “Нейронная сеть", Fdecomite," img_7801«Стив Рейнуотер,« E-Volve », Кеони Кабрал,«new_20x«Робертом Кадмором»Скрепки«Клиффорд Уоллес

Андре, писатель и журналист, работающий на юго-западе, гарантированно сохраняет работоспособность до 50 градусов по Цельсию и водонепроницаем на глубине до двенадцати футов.